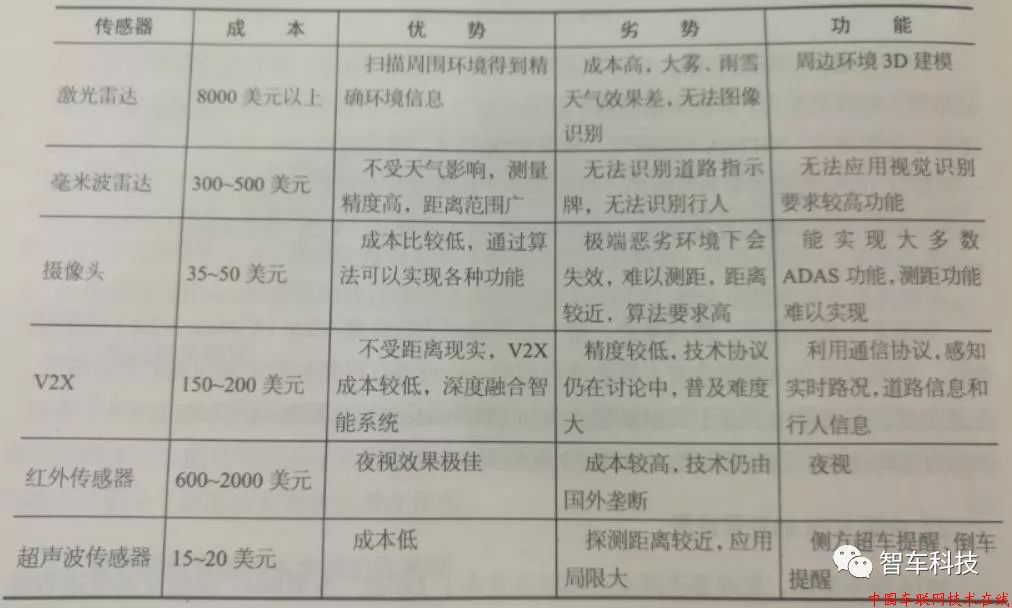

导读: 不同的传感器都有其优势和缺陷,无法在单传感器的情况下完成对无人驾驶功能性与安全性的全面覆盖,这显示了多传感器融合的必要性。

不同的传感器都有其优势和缺陷,无法在单传感器的情况下完成对无人驾驶功能性与安全性的全面覆盖,这显示了多传感器融合的必要性。因此,各个传感器之间借助各自所长相互融合、功能互补、互为备份、互为辅助才是完备的无人驾驶系统。如何融合这些传感器的优势,弥补不足是自动驾驶工程师们现在的主要工作之一。

目前,现有的车载传感器包括激光雷达、毫米波雷达、车载摄像机、GPS/IMU、V2X通信传感、红外探头、超声波雷达等。主流的无人驾驶传感平台以雷达和车载摄像头为主,并呈现多传感器融合发展的趋势。基于测量能力和环境适应性,预计雷达和车载摄像头会持续保持传感器平台霸主的地位,并不断与多种传感器融合,发展处多种组合版本。

激光雷达

为了解决测距的问题,引入了激光雷达这种传感器。常常应用在Level 3级别以上的无人车。

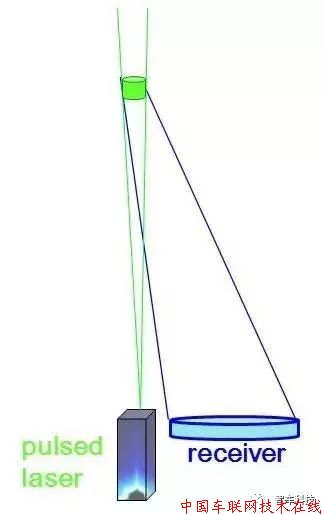

激光雷达的工作原理是利用可见和近红外光波(多为950nm波段附近的红外光)发射、反射和接收来探测物体。

如下图所示,激光雷达的发射器发射出一束激光,激光光束遇到物体后,经过漫反射,返回至激光接收器,雷达模块根据发送和接收信号的时间间隔乘以光速,再除以2,即可计算出发射器与物体的距离。

激光雷达可以探测白天或黑夜下的特定物体与车之间的距离。由于反射度的不同,也可以区分开车道线和路面,但是无法探测被遮挡的物体、光束无法达到的物体,在雨雪雾天气下性能较差。

激光雷达在无人驾驶运用中拥有两个核心作用。

一是3D建模进行环境感知。通过雷射扫描可以得到汽车周围环境的3D模型,运用相关算法比对上一帧和下一帧环境的变化可以较为容易的探测出周围的车辆和行人。

二是SLAM加强定位。3D雷射雷达另一大特性是同步建图(SLAM),实时得到的全局地图通过和高精度地图中特征物的比对,可以实现导航及加强车辆的定位精度。

激光雷达的分类

激光雷达根据安装位置的不同,分类两大类。一类安装在无人车的四周,另一类安装在无人车的车顶。

安装在无人车四周的激光雷达,其激光线束一般小于8,常见的有单线激光雷达和四线激光雷达。

安装在无人车车顶的激光雷达,其激光线束一般不小于16,常见的有16/32/64线激光雷达。

激光雷达雷射发射器线束越多,每秒采集的云点就越多。然而线束越多也就代表雷射雷达的造价就更加昂贵,以Velodyne的产品为例,64线束的雷射雷达价格是16线束的10倍。HDL-64E单个定制的成本在8万元左右。

目前,Velodyne公司已经开发出了相对便宜的LiDAR传感器版本HDL-32E和HDL-16E。其中HDL-16E是由16束雷射取代64束雷射,支持360度无盲区扫描,牺牲一定的数据规模云点,每秒钟只提供30万个数据点,但是售价仍高达售价8千美元。

当前人工智能的算法还不够成熟,纯视觉传感器的无人驾驶方案在安全性上还存在较多问题,因此现阶段的无人车的开发还离不开激光雷达。强如Google,目前也还没开发出脱离激光雷达的自动驾驶方案。

不过,激光雷达的普及所遇到的最大挑战是:成本过高。单独一个雷达的价格可能就超过了普通小汽车的价格,因此现阶段还没有大规模量产的可能性。激光雷达的降低成本之路任重道远。

毫米波雷达

毫米波雷达通过发射无线电信号(毫米波波段的电磁波)并接收反射信号来测定汽车车身周围的物理环境信息(如汽车与其他物体之间的相对距离、相对速度、角度、运动方向等),然后根据所探知的物体信息进行目标追踪和识别分类,进而结合车身动态信息进行数据融合,完成合理决策,减少事故发生几率。

毫米波雷达不受天气状况限制,即使是雨雪天都能正常运作,穿透雾、烟、灰尘的能力强。因此被广泛应用于车载距离探测,毫米波雷达在自动驾驶中最常见的三种用途是:

1. ACC(自适应巡航)

2. BSD&LCA(盲点监测和变道辅助)

3. AEB(自动紧急制动,通常配合摄像头进行数据融合)

毫米波雷达分类

频率在10GHz~200GHz的电磁波,由于其波长在毫米量级,因此处于该频率范围的电磁波也被工程师们称为毫米波。

应用在自动驾驶领域的毫米波雷达主要有3个频段,分别是24GHz,77GHz和79GHz。不同频段的毫米波雷达有着不同的性能和成本。

短距离雷达:24GHz频段

处在该频段上的雷达的检测距离有限,因此常用于检测近处的障碍物。在自动驾驶系统中常用于感知车辆近处的障碍物,为换道决策提供感知信息。

长距离雷达:77GHz频段

性能良好的77GHz雷达的最大检测距离可以达到160米以上,因此常被安装在前保险杠上,正对汽车的行驶方向。

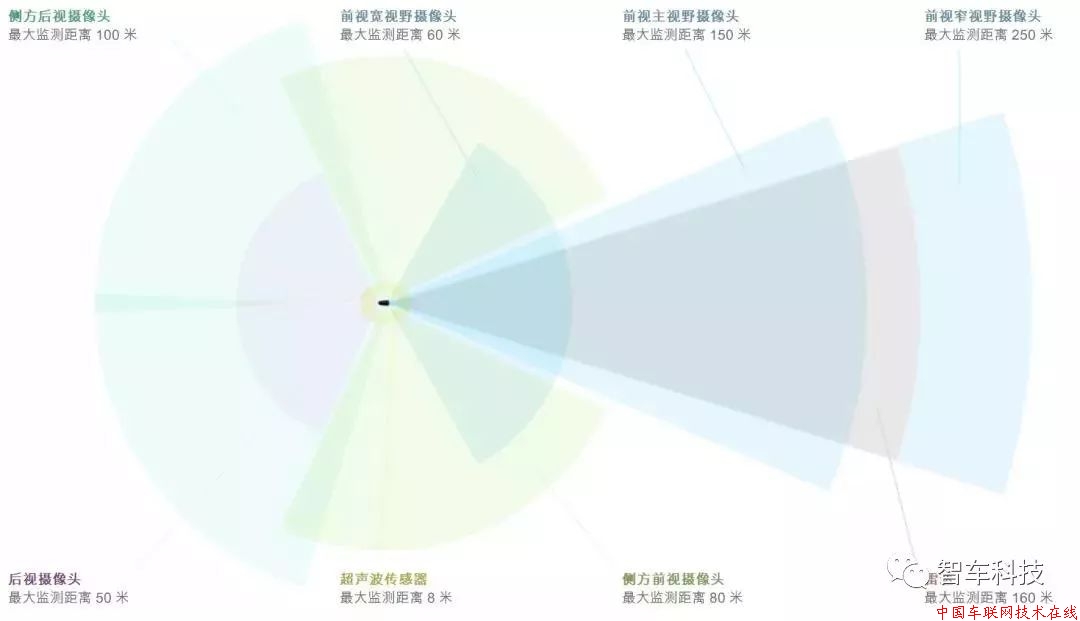

如下图右下角的棕色区域,为特斯拉AutoPilot 2.0中所配备的长距离毫米波雷达,及其感知范围。

长距离雷达能够用于实现紧急制动、高速公路跟车等ADAS功能;同时也能满足自动驾驶领域,对障碍物距离、速度和角度的测量需求。

长距离雷达:79GHz频段

该频段的传感器能够实现的功能和77GHz一样,也是用于长距离的测量。

根据公式:光速 = 波长 * 频率,频率更高的毫米波雷达,其波长越短。波长越短,意味着分辨率越高;而分辨率越高,意味着在距离、速度、角度上的测量精度更高。因此79GHz的毫米波雷达必然是未来的发展趋势。

毫米波雷达相比于激光有更强的穿透性,能够轻松地穿透保险杠上的塑料,因此常被安装在汽车的保险杠内。这也是为什么很多具备ACC(自适应巡航)的车上明明有毫米波雷达,却很难从外观上发现它们的原因。

然而实际开发的过程中,在自动驾驶领域应用毫米波雷达有一下三点挑战。

挑战1:数据稳定性差

数据的不稳定性对后续的软件算法提出了较高的要求。加大了工程师的工作难度。

挑战2:对金属敏感

由于毫米波雷达发出的电磁波对金属极为敏感,在实际测试过程中会发现近处路面上突然出现的钉子、远距离外的金属广告牌都会被认为是障碍物。一旦车辆高速行驶,被这些突然跳出的障碍物干扰时,会导致刹车不断,导致汽车的舒适性下降。

挑战3:高度信息缺失

毫米波雷达的数据只能提供距离和角度信息,不能像激光雷达那样提供高度信息。没有高度信息的障碍物点会给技术开发带来很多挑战。

超声波雷达

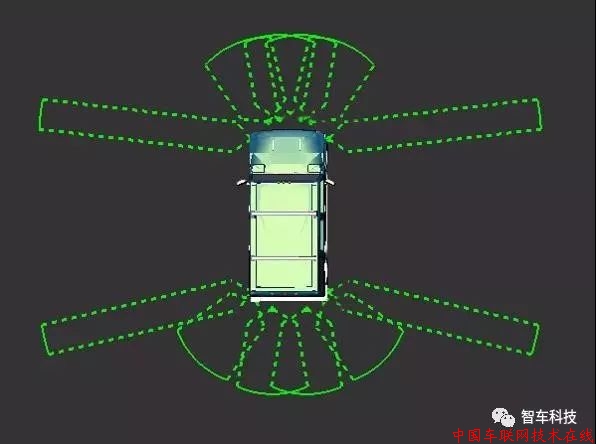

超声波雷达又名倒车雷达。常见的超声波雷达有两种。第一种是安装在汽车前后保险杠上的,也就是用于测量汽车前后障碍物的倒车雷达,这种雷达业内称为UPA;第二种是安装在汽车侧面的,用于测量侧方障碍物距离的超声波雷达,业内称为APA。作为无人车上成本最低的传感器,挖掘超声波雷达的潜力是工程师们不断在琢磨的事。

UPA和APA的探测范围和探测区域都太相同,如下图所示。图中的汽车配备了前后向共8个UPA,左右侧共4个APA。

UPA超声波雷达

UPA超声波雷达的探测距离一般在15~250cm之间,主要用于测量汽车前后方的障碍物。

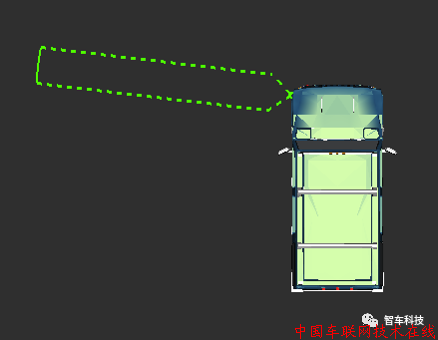

如图所示,为单个UPA的探测范围示意图。

APA超声波雷达

APA超声波雷达的探测距离一般在30~500cm之间。APA的探测范围更远,因此相比于UPA成本更高,功率也更大。

如图为单个APA的探测范围示意图。

APA的探测距离优势让它不仅能够检测左右侧的障碍物,而且还能根据超声波雷达返回的数据判断停车库位是否存在。

超声波雷达的应用

本文标题提到超声波雷达是被低估的传感器,因为它除了检测障碍物外,还可以做很多事。

应用1:泊车库位检测

自动泊车功能需要经历两个阶段:1.识别库位;2.倒车入库

识别库位功能就是依赖安装在车辆侧方的APA,如下场景。

汽车缓缓驶过库位时,汽车右前方的APA传感器返回的探测距离与时间的关系可判断当前空间有无车位。有了库位检测功能,进而开发自主泊车功能就不是难事了。

应用2:高速横向辅助

特斯拉Model S在AutoPilot 1.0时代就实现了高速公路的巡航功能,为了增加高速巡航功能的安全性和舒适性,特斯拉将用于泊车的APA超声波雷达,也用在了高速巡航上。

先看一段Model S应用APA的视频,视频左下角的图像是一个朝汽车后向的摄像机,右侧的图像是朝向行驶方向的视角。

在视频中可以看出,当左侧驶过的汽车理自车较近时,Model S在确保右侧有足够空间的情况下,自主地向右微调,降低与左侧车辆的碰撞风险。

车载摄像机

车载摄像机的大致原理是:首先,采集图像进行处理,将图片转换为二维数据;然后,进行模式识别,通过图像匹配进行识别,如识别车辆行驶环境中的车辆、行人、车道线、交通标志等;接下来,依据物体的运动模式或使用双目定位,以估算目标物体与本车的相对距离和相对速度。

摄像机根据镜头和布置方式的不同主要有以下四种:单目摄像机、双目摄像机、三目摄像机和环视摄像机。

单目摄像机模组只包含一个摄像机和一个镜头。由于很多图像算法的研究都是基于单目摄像机开发的,因此相对于其他类别的摄像机,单目摄像机的算法成熟度更高。但是单目有着两个先天的缺陷。

一是它的视野完全取决于镜头。

焦距短的镜头,视野广,但缺失远处的信息。反之亦然。因此单目摄像机一般选用适中焦距的镜头。

二是单目测距的精度较低。

摄像机的成像图是透视图,即越远的物体成像越小。近处的物体,需要用几百甚至上千个像素点描述;而处于远处的同一物体,可能只需要几个像素点即可描述出来。这种特性会导致,越远的地方,一个像素点代表的距离越大,因此对单目来说物体越远,测距的精度越低。

双目摄像机

由于单目测距存在缺陷,双目摄像机应运而生。双目摄像机,是通过对两幅图像视差的计算,直接对前方景物(图像所拍摄到的范围)进行距离测量,而无需判断前方出现的是什么类型的障碍物。依靠两个平行布置的摄像头产生的“视差”,找到同一个物体所有的点,依赖精确的三角测距,就能够算出摄像头与前方障碍物距离,实现更高的识别精度和更远的探测范围。使用这种方案,需要两个摄像头有较高的同步率和采样率,因此技术难点在于双目标定及双目定位。

相比单目,双目的解决方案没有识别率的限制,无需先识别可直接进行测量;直接利用视差计算距离精度更高;无需维护样本数据库。但因为检测原理上的差异,双目视觉方案在距离测算上相比单目以及毫米波雷达、激光雷达,其硬件成本和计算量级的加倍,也是另一个难关。

虽然双目能得到较高精度的测距结果和提供图像分割的能力,但是它与单目一样,镜头的视野完全依赖于镜头。而且双目测距原理对两个镜头的安装位置和距离要求较多,这就会给相机的标定带来麻烦。

三目摄像机

由于单目和双目都存在某些缺陷,因此广泛应用于无人驾驶的摄像机方案为三目摄像机。三目摄像机其实就是三个不同焦距单目摄像机的组合。

特斯拉 AutoPilot 2.0安装在挡风玻璃下方的三目摄像机

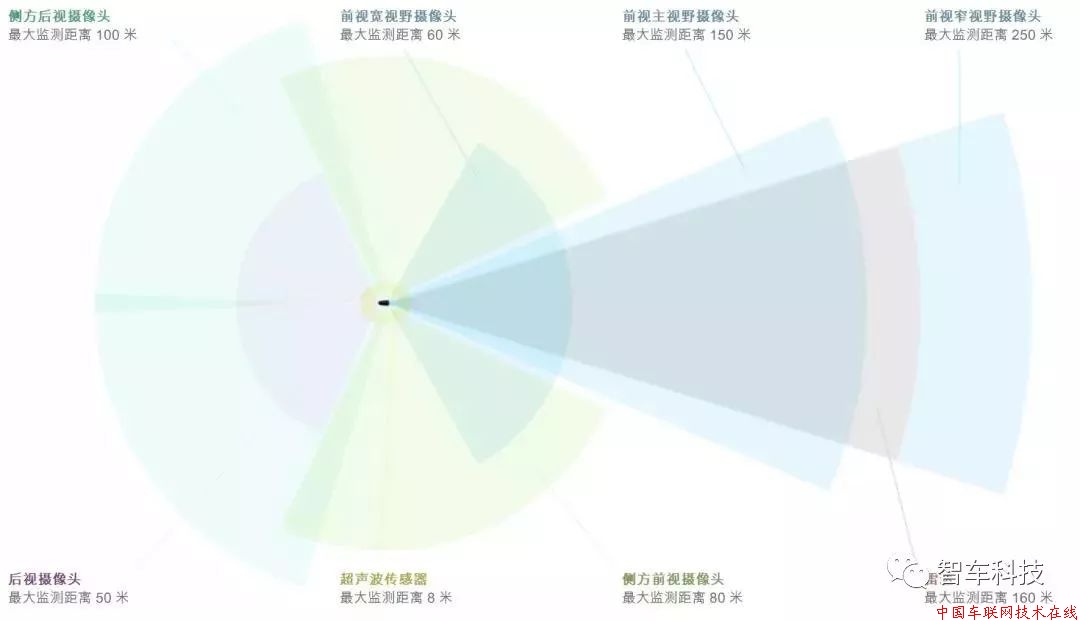

如下图,可以看出三个摄像头的感知范围由远及近,分别为前视窄视野摄像头(最远感知250米)、前视主视野摄像头(最远感知150米)及前视宽视野摄像头(最远感知60米)。

对摄像机来说,感知的范围要么损失视野,要么损失距离。三目摄像机能较好地弥补感知范围的问题。因此在业界被广泛应用。

那么测距精度的问题怎么办?

正是由于三目摄像机每个相机的视野不同,因此近处的测距交给宽视野摄像头,中距离的测距交给主视野摄像头,更远的测距交给窄视野摄像头。这样一来每个摄像机都能发挥其最大优势。

三目的缺点是需要同时标定三个摄像机,因而工作量更大一些。其次软件部分需要关联三个摄像机的数据,对算法要求也很高。

环视摄像机

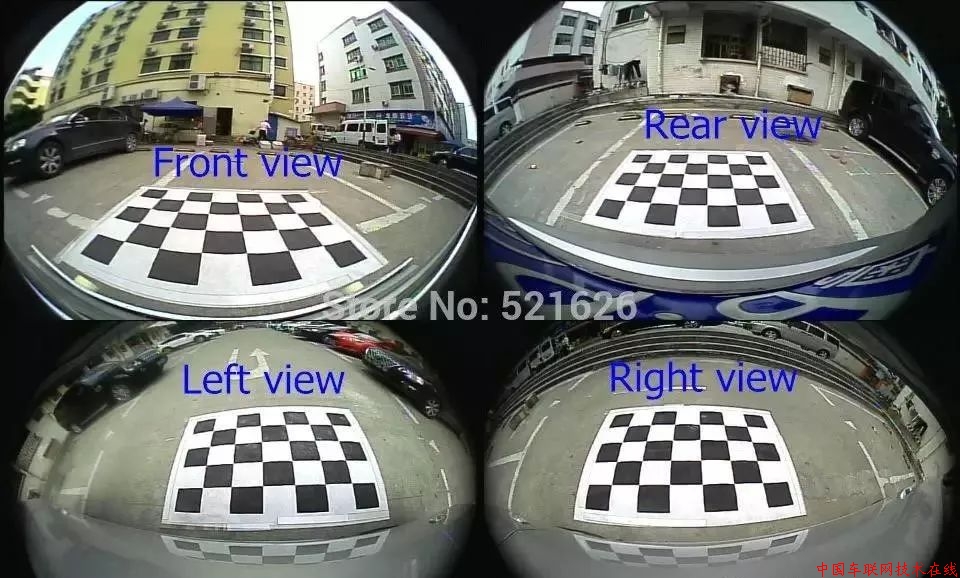

环视摄像机,一般至少包括四个摄像头,分别安装在车辆前、后、左、右侧,实现360°环境感知,难点在于畸变还原与对接。安装于车辆前方、车辆左右后视镜下和车辆后方的四个鱼眼镜头采集图像,采集到的图像与下图类似。

环视摄像机的镜头是鱼眼镜头,而且安装位置是朝向地面的。某些高配车型上会有“360°全景显示”功能,所用到的就是环视摄像机。鱼眼摄像机为了获取足够大的视野,代价是图像的畸变严重。

通过标定值,进行图像的投影变换,可将图像还原成俯视图的样子。之后对四个方向的图像进行拼接,再在四幅图像的中间放上一张车的俯视图,即可实现从车顶往下看的效果。如下图。

相比于其他传感器,摄像头最为接近人眼获取周围环境信息的工作模式,可以通过较小的数据量获得最为全面的信息,同时因为现在的摄像头技术比较成熟,成本可较低。但是,摄像头识别也存在一定局限性,基于视觉的解决方案受光线、天气影响大;同时,物体识别基于机器学习资料库,需要的训练样本大,训练周期长,也难以识别非标准障碍物;同时,由于广角摄像头的边缘畸变,得到的距离准确度较低。

摄像机的功能

摄像机在无人车上的应用,主要有两大类功能。分别是感知能力,其次是定位能力。

摄像机的感知能力表现在可以识别车道线(lane)、障碍物(Obstacle)、交通标志牌和地面标志(Traffic Sign and Road Sign)、交通标志牌和地面标志(TrafficSign and Road Sign)和交通信号灯(Traffic Light)

定位能力体现在获取当前无人车的位置。视觉SLAM技术根据提前建好的地图和实时的感知结果做匹配,从而获取当前无人车的位置。视觉SLAM需要解决的最大问题在于地图的容量过大,稍微大一点的区域,就对硬盘的容量要求很高。如何制作出足够轻量化的地图,成为SLAM技术商业化的关键。

摄像机是所有车载传感器中,感知能力最强的。为此特斯拉采用了纯视觉的感知方案,而没有使用激光雷达,当然激光雷达价格昂贵也是一个因素。

GPS/IMU

GPS是全球定位系统(GlobalPosition System)的简称,IMU(Inertial Measurement Unit)惯性测量单元。

GPS在复杂的动态环境中,尤其在大城市,其多路径反射的问题很显著,导致获得的GPS定位信息很容易产生几米的误差。另外,由于GPS的更新频率低(10Hz),在车辆快速行驶时很难给出精准的实时定位。单纯依赖GPS的导航很有可能导致交通事故。因此GPS通常辅助以惯性传感器(IMU)用来增强定位的精度。

IMU是检测加速度与旋转运动的高频(1KHz)传感器,但IMU自身也有偏差积累与噪音等问题影响结果。通过使用基于卡尔曼滤波的传感器融合技术,我们可以融合GPS与IMU数据,结合GPS的定位精度高和误差无积累的特点,与IMU的自主性和实时性的优点。一方面可以实现导航设备之间优势互补,增强系统适应动态的能力,并使整个系统获得优于局部系统的精度;另一方面提高了空间和时间的覆盖范围,从而实现真正意义上的连续导航。因此,GPS/IMU组合的优势在于:

1.系统精度的提高。利用GPS的长期稳定性弥补IMU误差随时间累积的缺点。GPS/IMU组合后的导航误差实际上要比单独的GPS或单独的惯导系统可能达到的误差都小。

2.系统抗干扰能力的增强。利用IMU的短期高精度弥补GPS系统易受干扰、信号易失锁等缺点,同时借助IMU的姿态信息、角速度信息可进一步提高GPS系统快速捕获或重新锁定卫星信号的能力。

3.导航信息的补全。GPS/IMU组合系统与单GPS相比,除了可以提供载体运动的三维位置和速度信息外,还可提供加速度、姿态和航向信息;GPS/IMU组合系统此外可提供100Hz甚至高于100Hz的数据更新率。

IMU惯性器件的标定技术由于加速度计、陀螺仪等惯性器件本身存在缺陷,会产生一些器件误差,如标度因数误差等。另外,在对IMU进行集成的时候,各个器件之间的非正交安装会引起交叉耦合误差。以上这些误差可以通过器件标定来加以补偿,以达到提高其精度的目的。

V2X通信传感

V2X是V2V(Vehicle toVehicle,车车通信)、V2I(Vehicle to Instruction,车路通信)、V2P(Vehicle to Pedestrain)等的统称。通过V2X可以获得实时路况、道路信息、行人信息等一系列交通信息,从而带来远距离环境信号。

V2X通信系统可以看做是一个超级传感器,它提供了比其他传感器都高得多的感知能力和可靠性,在自车感知技术尚不能达到高可靠性之前,用V2X可以决定性地其可靠性。V2X是无人驾驶的必要技术和智慧交通的重要一环。

简单来说,V2X技术是利用无线通信技术实现车与车之间、车与道路之间、车与行人之间的信息互通,也就是说,通过人、车、路之间的互相交流,驾驶员能够更好地掌握车辆状态和周围情况,从而有效降低事故发生的风险。V2X通信技术首次由福特公司于2014年6月发布,现场展示了福特的两辆经过特殊改造过的汽车,通过一台连接了WiFi的无线广播系统,演示了这项V2V通信技术是如何防止碰撞事故发生的。

详细来说,V2X是一种网状网络,网络中的节点(汽车、智能交通灯等)可以发射、捕捉并转发信号。利用V2X车联网,车辆可以获取周围环境的未知参数及附近车辆的运行状态,这些状态包括速度、位置、驾驶方向、刹车等基本的安全信息。然后车载端主动安全算法将处理所获取的信息,并按照优先级对信息进行分类,对可能发生的危险情景进行预警,紧急情况下可以利用车辆执行端对车辆进行控制从而规避风险。V2X技术开启了对四周威胁的360度智能感知,这一技术能够在各种危险的情况下提醒驾驶者,从而大大减少碰撞事故的发生并缓解交通拥堵。美国交通部根据最新的数据进行分析,如果能够大面积地普及V2X技术,就能在75%的交通事故发生之前提醒驾驶员。

相比传统雷达,V2X通信传感系统有以下几点优势:

1)覆盖面广

300-500米的通信范围相比10几米的雷达探测范围要远得多,不仅是前方障碍物,身旁和身后的建筑物、车辆都会互相连接通信。

2)有效避免盲区

路边联入互联网的物体都会有单独的信号显示,因此即便视野受阻,通过实时发送的信号可以显示视野范围内看不到的物体状态,因而降低忙去出现的概率,也就充分避免了因盲区而导致的潜在伤害。

3)对于隐私信息的安全保护性更好

由于这套系统将采用5.9Hz频段进行专项通信,相比传统通信技术更能确保安全性和私密性,如果通信协议及频道在各个国家都能规范化,这套系统将变得像SOS救援频道一样成为社会公用资源。

小结

不同的传感器都有其优势和缺陷,无法在单传感器的情况下完成对无人驾驶功能性与安全性的全面覆盖,这显示了多传感器融合的必要性。因此,各个传感器之间借助各自所长相互融合、功能互补、互为备份、互为辅助才是完备的无人驾驶系统。如何融合这些传感器的优势,弥补不足是自动驾驶工程师们现在的主要工作之一。

联系人:郑生

联系人:郑生 手机:13590332825

手机:13590332825 电话:0755-86635400

电话:0755-86635400 邮件:126352@qq.com

邮件:126352@qq.com 地址:深圳市南山区丽山路66-49号

地址:深圳市南山区丽山路66-49号